はじめに:SEOの基本的な考え方

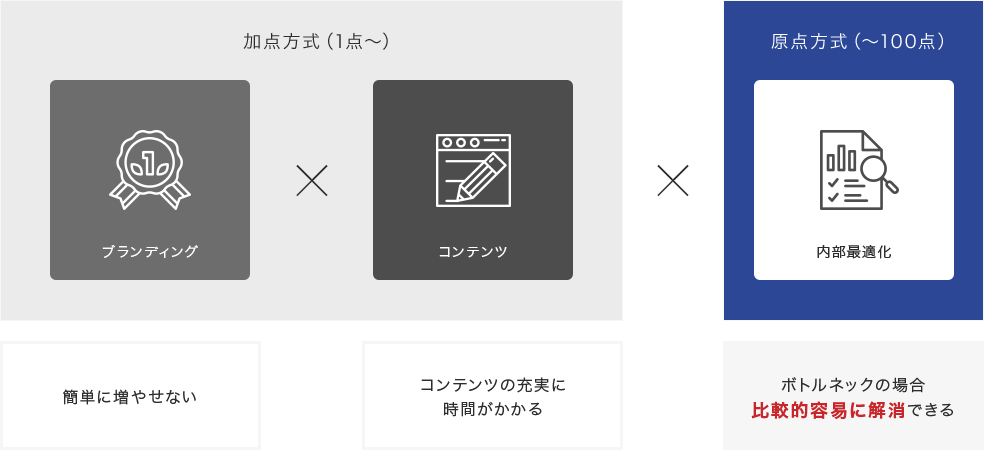

SEOには大きく3つの要素があります。

- ①ブランディング(リンク、サイテーション、ブランド検索数など)

- ②コンテンツ(テキスト、動画、画像、商品情報など)

- ③テクニカル(Google がそのサイトをどう読み解き、どう評価するか)

Googleはいかに効率的に①ブランディングと②コンテンツを読み取り評価するか、ということに力を注いでおり、「Googleの評価基準に合わせて」「Googleフレンドリーに」サイトを改善する③テクニカルの要素はSEOにおいて重要となってきます。

広告企業であるGoogleにとって、企業売上に直結する指標は「インターネット上の総検索数」と「ウェブサイトの総PV数」です。Googleはこれらを長期視点で伸ばすために、「ユーザーの検索に対してクリックされ、検索意図を満たして満足させた」という一連の行動の最大化をKPIとし、検索エンジンを構築していると考えられます。

そのためGoogle が本質的に評価したいのは「①ブランディング」と「②コンテンツ」です。

しかしながら、無数に存在し数十兆GBという大量のデジタルデータからなるインターネットを日々クロールすることには非常に多くのコストがかかります。Googleとしては「いかに効率的にユーザーが求める情報を把握するのか」がアルゴリズム上重要なファクターとなっていることは想像に難くありません。

URLが大量に存在する大規模サイトの場合、もしGoogleクローラーのことを考えずにサイトが構築されていると、似たコンテンツで異なるURLが大量に存在したり、不要なパラメータが多数存在したりとGoogle から見て非効率です。

こういった大規模サイトにおいては、Google任せではなく、しっかりGoogle にとって投資対効果のよい(クロールリソースに対して有意義な情報へたどり着く割合が高い)サイトにしてあげることが重要です。これにより、より多くのクローラーが訪れ、より高い評価を得ることができます。

以上が基本的な考え方ですが、これらをGoogle サーチコンソール(以下GSC)の「インデックスカバレッジレポート」でどのように読み解いていくのかを、シリーズでご紹介したいと思います。

第1回目は以下のアジェンダにてお届けします。

記事の内容

- インデックスカバレッジレポートの基本構造

- 「エラー」はSEOに悪影響

- 「有効(警告あり)」について

- 除外の捉え方とクロールバジェット

インデックスカバレッジレポートの基本構造

GSCのインデックスカバレッジレポートは以下のようになっています。

- ①エラー

- ②有効(警告あり)

- ③有効

- ④除外

これら4つの数値は、Googleが認識しているURLがそれぞれどのように分類されているかを示します。

Googleのヘルプを読みとくと、標準的には以下のような理解をしている方が多いのではないかと思います。

- 少ない方が良い:①エラー、②有効(警告あり)

- 多い方が良い:③有効

- 多くても少なくても影響ない:④除外

これは「Googleにとっての効率性」を気にしなくてよい小規模サイトにおいては正しいですが、「Googleにとっての効率性」が重要となる大規模サイトでは、以下のように捉えると良いと思います。

- 少ない方が良い:①エラー、②有効(警告あり)、④除外

- 狙った適正な値を目指す:③有効

なぜこうなるのか、それぞれ見ていきたいと思います。

「エラー」はSEOに悪影響

サーチコンソールでは、色々なレポートで「エラー(赤色)」と「警告(黄色)」という用語が用いられています。日本語だけ聞くとどちらも悪いことのようですが、色の通りレッドカードとイエローカードと捉えると分かりやすいでしょうか。

エラー(赤色)はGoogleから見て悪影響があることを示しており、サイトのSEOパフォーマンスを悪化させています。基本的にはこれらを減らしていくことで、サイトトラフィックの改善に繋がります。

エラーの種類については、GSCのヘルプページに簡易な説明があります。

Index Coverage report – Search Console Help

大規模サイトになると、エラーを完全にゼロにすることは難しいケースが多いと思います。しかし個別ページのトラブルではない、構造的な問題(多数のエラーURLを生み出している課題)については、1つ1つ解決することが重要です。

「有効(警告あり)」について

インデックスカバレッジレポートの「有効(警告あり)」については、多くの場合が「robots.txt によりブロックされましたが、インデックスに登録しました」という内容かと思います。

この警告は「間違えてrobots.txt でブロックしてしまっている場合」と「ブロックしたいがGoogleが勝手にインデックスしてしまっている場合」とに分かれます。robots.txt でブロックされたURLがsitemap.xml で送信された場合などもここに分類されるようです。

解決した方が良いのは間違いないですが、Google側の問題が含まれるケースも多く、優先度が低い場合が多いです。

「除外」の捉え方とクロールバジェット

「除外」については、Google が読み取り、「インデックスする必要がない」と適切に判断したものなので、存在そのものは悪ではありません。しかし、「Googleにとっての効率性」の視点からとらえると、ネガティブにはたらく要素です。

実際、大規模サイトにおいて、これら「インデックスする必要がない無駄なURL」を減らすことで、SEOのパフォーマンスが上がることも多いです。

理由としては、以下の2つの要素があります。

理由1. Googleの効率性の観点

「除外」のURLが多いとクローリングにおける「有効コンテンツヒット率」が下がるため、ドメインとしてのクロール優先度(≒クロールバジェット)にマイナスにはたらきます。

理由2. 有効コンテンツのインデックス率の観点

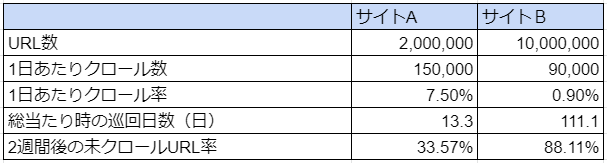

多くの大規模サイトにおいては、日々新しい商品やページが生成されています。例えば、カバレッジレポートで認識されているURLの数と、1日あたりクロール数(設定>クロールの統計情報)が以下のような数値のサイトがあったとします。

1日あたりのクロール数は、総URL数よりも少ないケースが大半です。大規模サイトの場合、その割合(1日あたりクロール率)は、1-10% 程度なケースが多いのではないでしょうか。(皆さんの担当するサイトでも計算してみてください)

もし、GoogleがURLに優先順位をつけずに機械的に順番にURLを回るとすると、サイトAの場合、新しいURLが2週間後にインデックスされていないものが3割、サイトBに至っては9割のURLが、まだクロールすらされていない、という状況に陥ってしまうことが分かります。

実際には、Googleは新しいURLを優先的に巡回しますので上記のように極端なことは起こりませんが、「1日あたりクロール率」が、サイトの有効コンテンツのインデックス率に影響を与えることが理解いただけると思います。

日々新しい商品が追加されるようなサイトで上記のようなカバー率だと、「常に9割の商品しか評価されていない」というようなケースもあります。このようなケースでは、分母(総URL数)を減らすことで、そのカバー率を上げることができます。

大規模サイトにおいて、総URL数を押し上げる要因は多くの場合「除外URL」ですので、これを減らすことがサイト評価に繋がる理由の1つです。

次回は、「除外URL」についての深堀りと、「有効URL」をどのように捉えればよいのかを説明していこうと思います。